由于漫长的病程,阿尔茨海默病(AD)的早期诊断一直都是个难题。认知障碍是AD最具特征方便临床识别的病理表现之一,但认知障碍出现之时,AD往往已经发展多年,错过了最佳的干预窗口。

近年来,IWG-2和NIA-AA在AD诊断标准框架中增加了来自脑脊液(CSF)和PET的生物标记物,大大提高了诊断的敏感性和特异性。但是侵入性和可及性限制了生物标记物在临床环境中的应用。

那么还有什么新的思路吗?

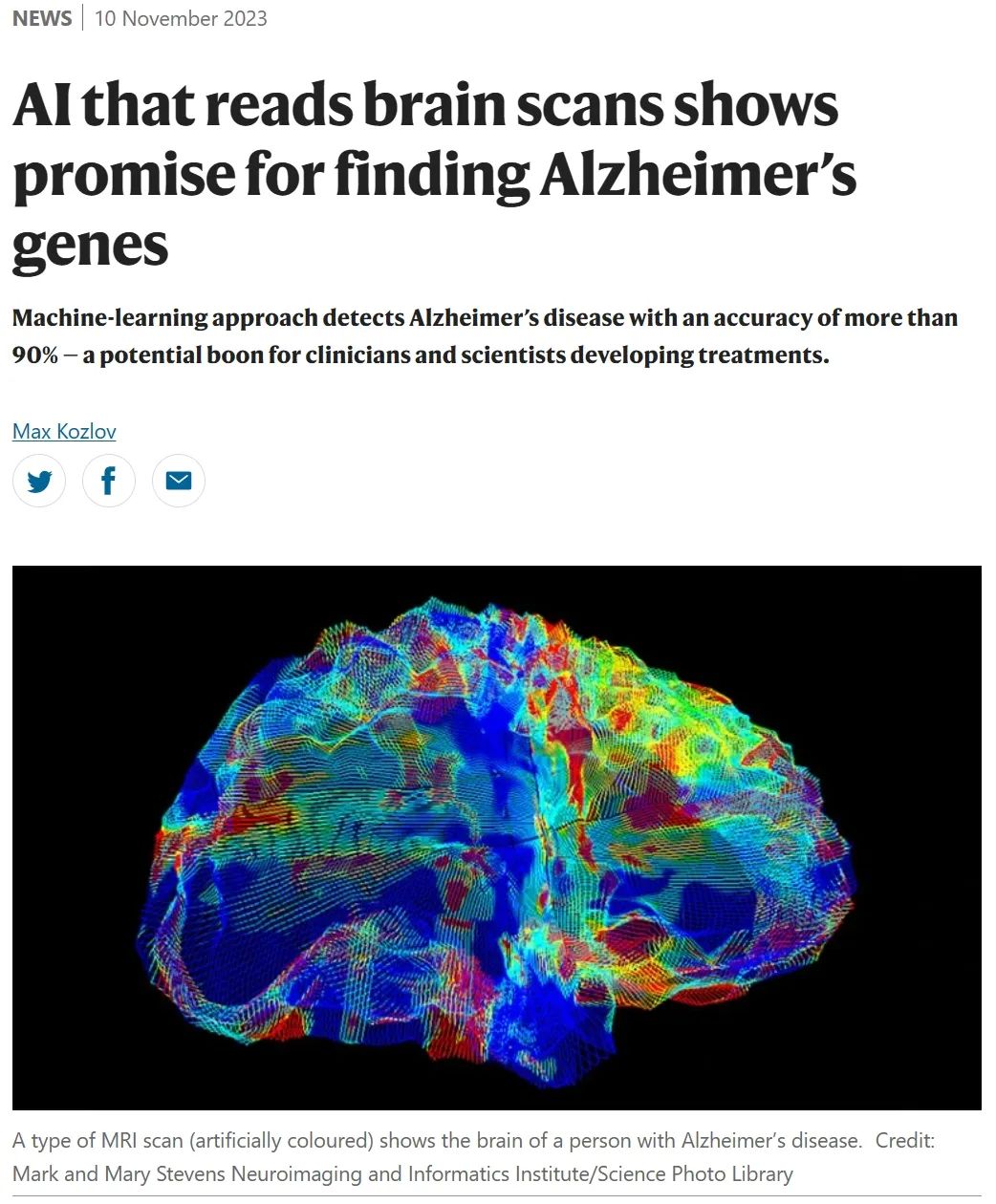

相对来说,核磁共振成像(MRI)在神经放射学中广泛应用,只是限于AD的神经影像学特征较不明确,暂时无法用于AD诊断。

近年来大有作为的机器学习和深度学习方法刚好可以用来解决这个问题。

近期,《自然》杂志对AI读片诊断AD的未来投以关注,奇点糕也借此机会为大家介绍一下文中提及的研究。

既往并非没有研究团队尝试AD的AI读片,但这些研究涉及的数据量往往较少,泛用性不足。MRI影像质量受设备设计、参数设置、操作者和参与者特征等多重因素影响,使用单一来源数据训练的模型往往无法应用到另一数据集。

解决这一问题,一个方法是要有足够的训练数据集,另一个就是迁移学习。

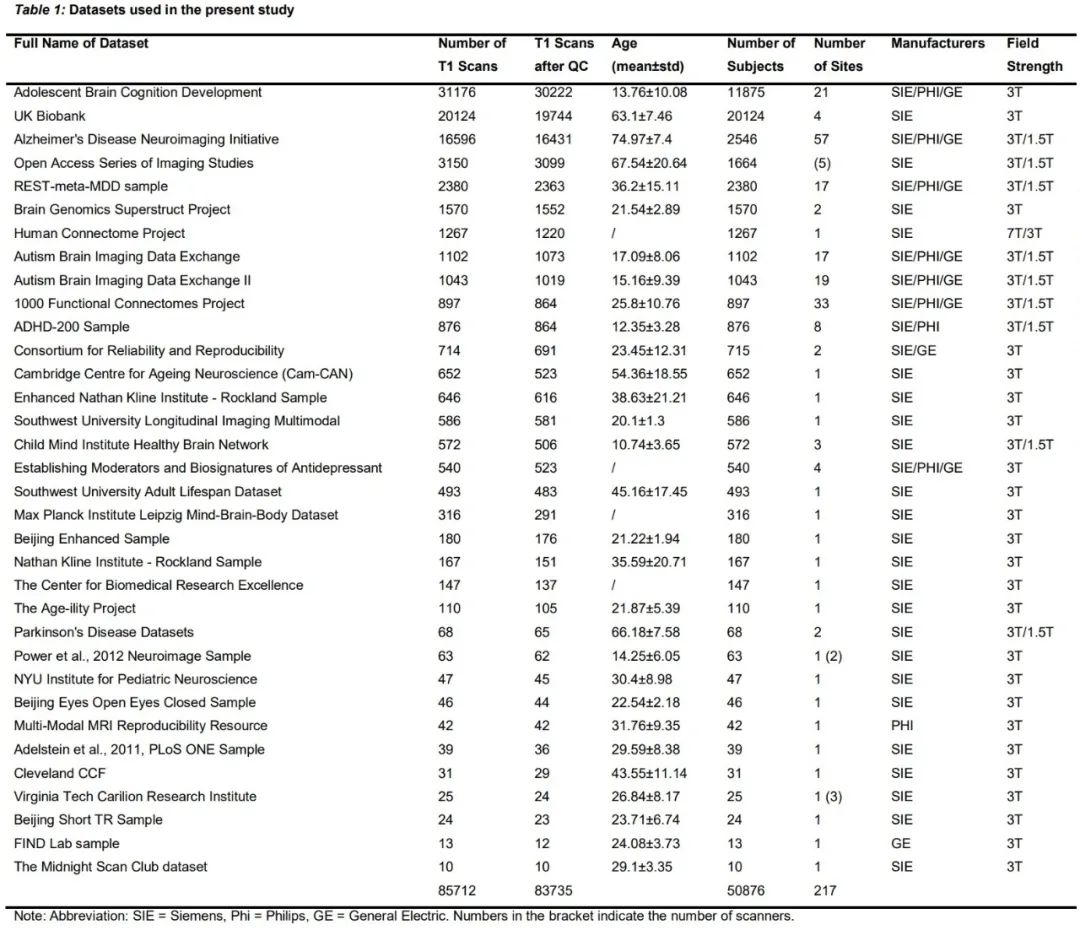

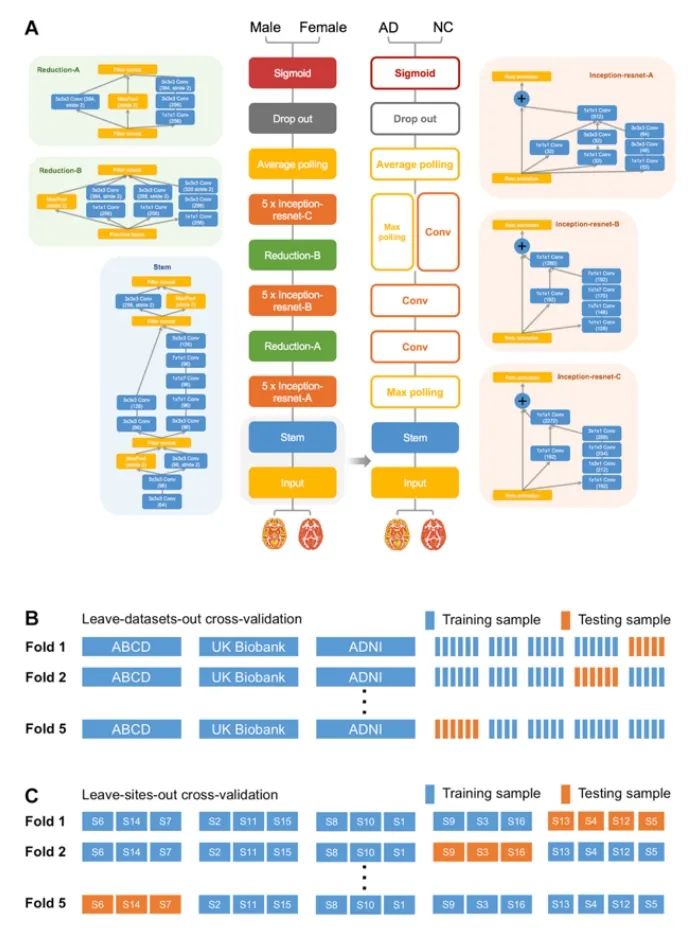

这项研究使用的数据来自包括英国生物库和ADNI在内的34个大型队列,总计217个成像设备生成的50876名参与者的85721份影像数据。其中,ADNI、AIBL、MIRIAD、OASIS额外被挑选出来用于训练和测试模型。

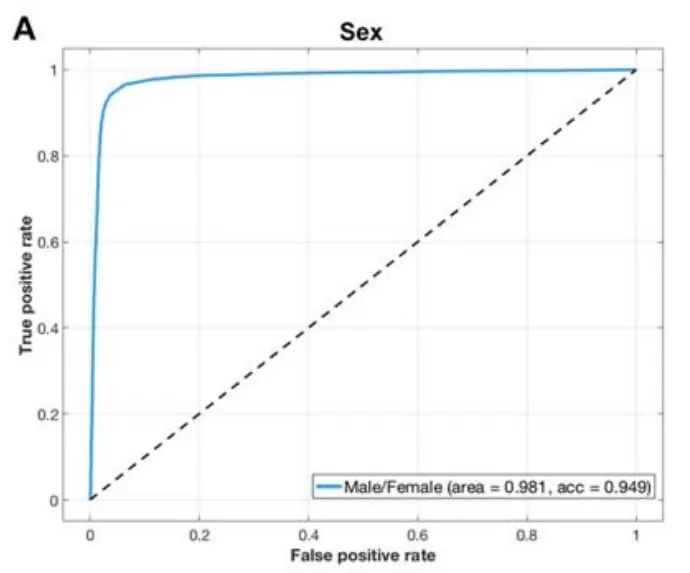

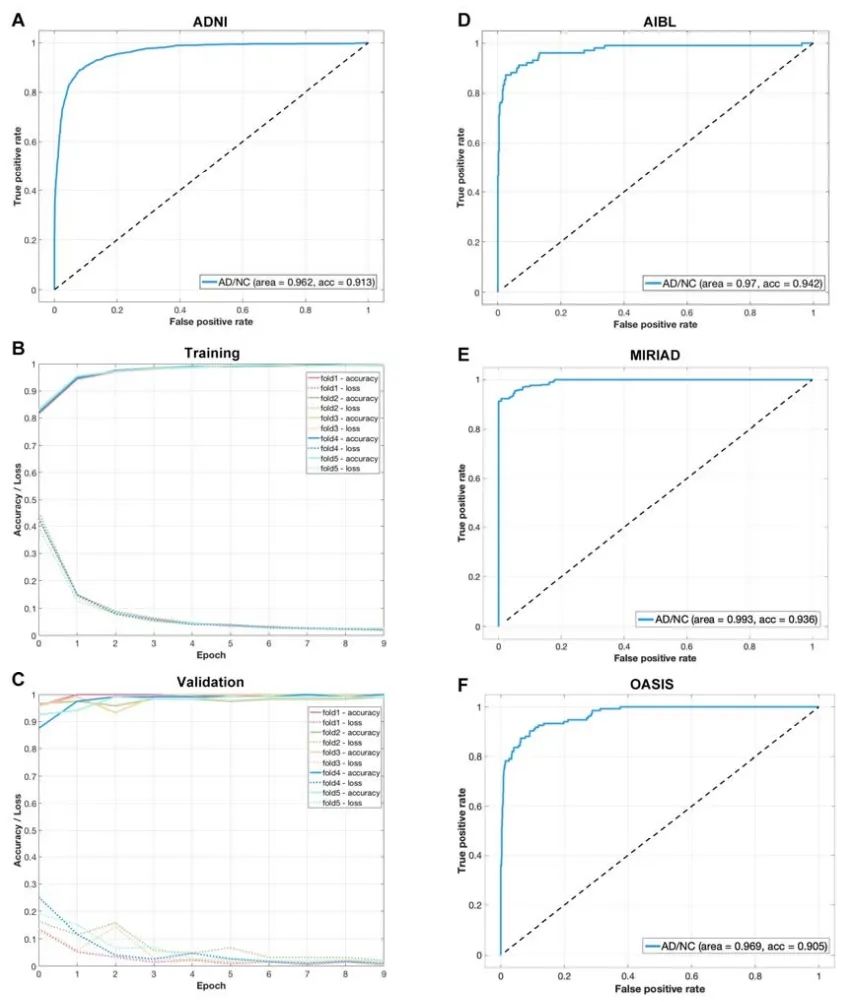

通过迁移学习将该模型用于区分AD患者,精确度达到90.9%,平均敏感性和特异性分别达到0.838和0.942。

将其应用到unseen数据集,在AIBL中精确度达到94.5%,AUC为0.966,敏感性和特异性分别为0.881和0.958;在MIRIAD中,精确度达到93.6%,AUC为0.994,敏感性和特异性分别为0.897和1.000;在OASIS中,精确度达到91.1%,AUC为0.976,敏感性和特异性分别为0.932和0.908。

研究者们还在ADNI的MCI数据集中进行了测试。尽管该模型从没“见过”MCI患者的脑成像特征,但仍有效地预测了MCI向AD的转化。

数据集中,转化为AD的MCI患者被模型预测为AD的可能性是65.2%,未转化者为20.6%,前者是后者的三倍。

由此来看,AI读片在AD中的应用真是潜力无限。如果它能投入临床使用,相信能够给AD诊断带来不少方便。

参考资料:

[1]Lu, B. et al. Preprint at bioRxiv https://doi.org/10.1101/2020.08.18.256594 (2022).

来自: 奇点神思

更多阅读: