云端 AI 芯片

人工智能兴起的背后关键因素之一是云计算能力的提升,而这主要是由云端 AI 芯片的增强和升级推动的。云端 AI 芯片是专注于 AI 工作负载的计算芯片,通常部署在云或数据中心应用环境中。

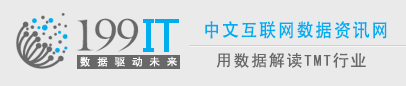

ABI Research 的第一份报告“云端 AI 芯片:市场前景和供应商定位”表示:云端 AI 推理和训练所产生的 AI 芯片市场,预计将从 2019 年的 42 亿美元增长到 2024 年的 100 亿美元。

2017 年至 2024 年 AI 芯片销售年度总收入对比及预测(资料来源:ABI Research)

与终端 AI 芯片相比,云端 AI 芯片通常具有更高的计算能力,更高的功耗,更大的物理占用面积,因此也相对更加昂贵。

到目前为止,云端 AI 市场一直由英伟达的 GPU 和英特尔的 CPU 主导,而现在的它们正面临着寒武纪科技、Graphcore、Habana Labs 、高通等公司的挑战。

如今的云端 AI 芯片市场可大致分为三个部分:

- 公共云,由云服务提供商托管,如:AWS、Microsoft Azure、Google、阿里云、百度云和腾讯云等。

- 私有云 + 混合云,主要用于企业数据中心,如:VMware、Rackspace、NetApp、HPE、Dell 等公司的各类产品。

- 电信云,由电信公司为核心网络,IT 和边缘计算工作负载部署的云基础架构,是新兴的市场 。

混合云(Hybrid cloud):由两个或更多云端系统组成云端基础设施,这些云端系统包含了私有云、社群云、公用云等。

云端推理 AI 芯片市场呈现出不同的景象,该市场并非由单一玩家主导,这在一定程度上取决于推理任务的性质,以及在垂直方向上各不相同的领域。ABI Research 预计:从 2020 年起,ASIC(专用集成电路)将在该领域实现强劲增长。

谷歌的 TPU 就是这样一个例子,它主要应用于云端 AI 相关的训练和推理任务,被视为 CPU 和 GPU 技术的强大挑战者。正如报告中所述,谷歌在 TPU 上的成功为其他云服务提供商提供了开发 AI 专用芯片的蓝图。据 ABI Research 预测,到 2024 年,15%至 18%的市场将落在云服务供应商之下。

云端 AI 芯片相关公司

终端 AI 芯片

随着 AI 推理任务向边缘转移,终端 AI 芯片变得更加重要。

终端 AI 芯片,指专注于 AI 工作负载的计算芯片,多应用于 AI 推理任务,通常部署在包括:终端设备、网关、内部部署服务器等终端环境中。在某些情况下,终端 AI 芯片还可以支持 AI 训练,尤其是深度学习模型的训练。

终端,即手机、安防摄像头、汽车、智能家居设备、各种 IoT 设备等执行边缘计算的智能设备。终端的数量庞大,而且需求差异较大。

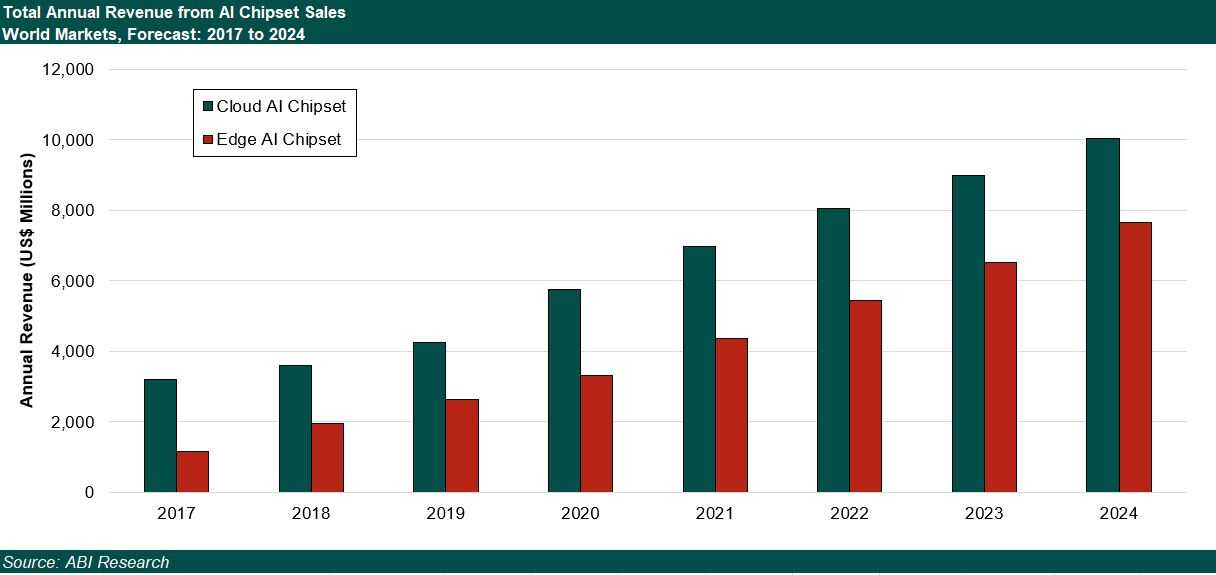

ABI Research 的第二份报告“终端 AI 芯片:技术展望和使用案例”中:终端 AI 芯片市场,预计到 2024 年会增长至 710 亿美元,2019 年至 2024 年之间的复合年增长率为 31%。

2017 年至 2024 年,通过推理和训练,AI 芯片销售的年度总收入(资料来源:ABI Research)

这种强劲的增长主要得益于 AI 推理任务向终端迁移,特别是在智能手机、智能家居、自动驾驶、可穿戴设备和机器人等行业。

目前,终端推断有这样三个利基市场:

- 机器人,由于机器人依赖于许多类型的神经网络,所以它通常需要异构计算架构。例如用于导航的 SLAM、用于人机界面的会话 AI、用于对象检测的机器视觉等,它们都会在不同程度上使用 CPU、GPU 和 ASIC。英伟达、英特尔和高通在这个领域竞争尤为激烈。

- 智能工业应用,包括制造业、智能建筑以及石油、天然气部门。在这一方面,FPGA 供应商表现优异,这主要归功于 FPGA 的可编程性,在面对传统设备时,FPGA 具备的较高灵活性和适应性。

- “非常终端”,即广域网中传感器和其他小端节点中需要嵌入的超低功耗 AI 芯片。鉴于重点着力于超低功耗,这个市场主要由 FPGA 公司、RISC-V 设计和 ASIC 供应商组成。

利基市场,指企业选定一个很小的产品或服务领域,集中力量进入并成为领先者,从当地市场到全国再到全球,同时建立各种壁垒,逐渐形成持久的竞争优势。

此外,该报告还研究了开源芯片的当前发展。在 RISC-V 下,开源芯片初创公司已经开始开发具有高并行计算能力的 AI 专用芯片。由于对整个行业的参与和贡献,开源 AI 芯片将更符合市场要求和期望,大大降低了产品维护和升级中的错误和开发成本。

来自:InfoQ

更多阅读: