Omdia公司监管部门首席分析师 Sarah McBride在接受采访时提到:”新技术的采用往往会引发争论,但人工智能的争论尤其迅速,讨论迅速成为公众的主流”,事实证明,人工智能技术是如此具有争议性,以至于连人工智能公司自己都在呼吁制定法规,为它们提供明确的工作界限。Sarah McBride 指出:”某种形式的监管是不可避免的,但在缺乏指导方针的情况下,企业正在创建自己的标准框架,用于开发、评估和部署负责任的人工智能。然而,由于不知道未来的法规到底会是什么样子,这些公司现在有可能做出错误的选择,这在未来可能很难扭转”。

新加坡已经发布了第二份《国家人工智能战略》,而欧盟委员会则是第一个在 2021 年 4 月发布人工智能监管框架草案的监管机构。它采用了基于风险的方法,根据安全风险等级对人工智能系统实施禁止,而英国等其他一些国家的监管行动计划则规定了针对特定行业的人工智能监管方法。同时,在美国,人工智能监管的初步方法侧重于特定的人工智能用例,国家标准与技术研究院一直在制定人工智能技术的设计、测试和部署标准。中国在人工智能监管框架方面也取得了进展,在涉及人工智能开发、部署和安全时,优先考虑生成式人工智能等方面,并关注主权问题。

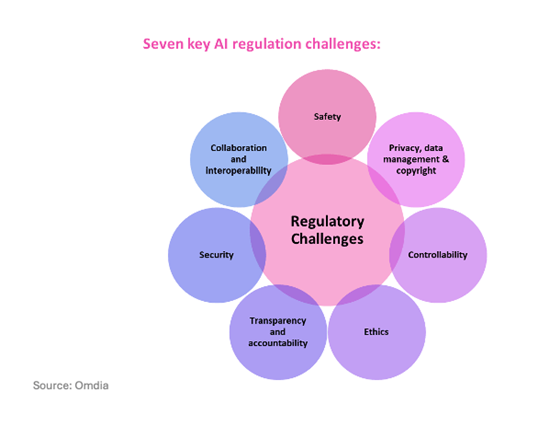

Omdia 的报告指出了监管机构必须应对的七大挑战,以确保人工智能发展带来的众多机遇得以实现,其中包括:安全性、隐私、道德、可控性、透明度和问责制、安全性以及版权和知识产权法。监管机构已经开始着手解决其中的一些问题,迄今为止发布的大多数指导方针都非常关注与人工智能实施相关的道德和法律问题,但预计明年这一进程只会加快,因为监管机构将重点关注特定行业的法律以及人工智能应用与现有监管政策之间可能存在利益冲突的领域,如数据保护法、版权法、过时的用户同意方法、许可协议或许可证以及特定行业的法律。

McBride 说:”第一步应该是确定哪些部门或用例由于不适当的立法而严重阻碍了人工智能的采用,并修订其中几项现行甚至过时的法规,以避免扼杀创新。该行业面临的另一个挑战是,在直接监管人工智能的领域(如欧盟《人工智能法》)与通过其他现有立法和新立法(如欧盟《DSA》和《DMA》)监管人工智能的领域之间可能存在争议。”

人工智能的广泛性给监管和保护最终用户免受伤害带来了问题。它不仅模糊了市场的传统定义,给执法带来挑战;而且还超越了国际行政边界。人工智能还对监管机构预测人工智能服务的特定结果何时会是恶意的提出了挑战。McBride说:”这促使世界各国政府和监管机构加快努力,评估需要多大程度的监管参与。”

来自:Omdia

更多阅读: